Das Verwandeln eines einzelnen Bildes in eine lebendige, bewegte Szene erfordert heute keine Animationssoftware, Motion Designer oder wochenlange Nachbearbeitung mehr. Im Jahr 2026 hat sich die KI von Bild zu Video zu einem praktischen Kreativwerkzeug entwickelt, das jeder nutzen kann – wenn er die richtige Plattform wählt.

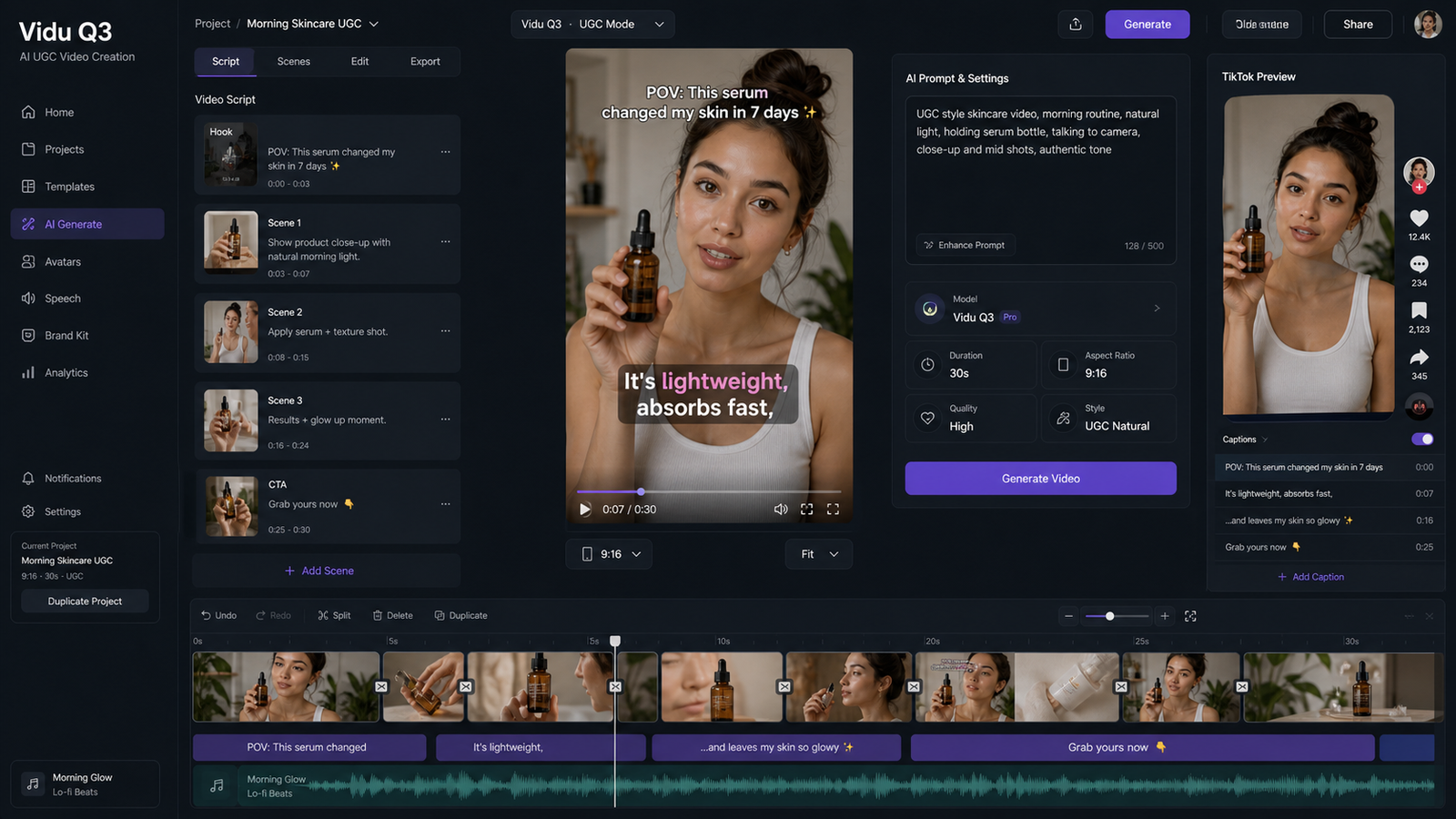

Hier kommt der Photo-to-Video Generator von Virtual Try On AI ins Spiel. Anstatt Kreative auf ein einzelnes Modell oder einen einzigen Stil festzulegen, fungiert er als zentrales Hub für mehrere erstklassige Videomodelle, wodurch du für jede Szene, jedes Budget und jeden Stil den passenden Motor auswählen kannst.

Egal, ob du nach der besten KI von Bild zu Video für Werbung, Storytelling, Modevisualisierungen oder Kurzvideos für soziale Medien suchst: Dieser Leitfaden erklärt, wie das Werkzeug funktioniert, welche Modelle eingesetzt werden und warum Virtual Try On AI 2026 zu einer bevorzugten KI-Bild-zu-Video-Plattform geworden ist.

Warum KI von Bild zu Video 2026 wichtig ist

Statische Bilder können in heutigen Feeds kaum noch mithalten. Plattformen belohnen Bewegung, Tiefe und Emotion – und das Publikum erwartet Inhalte, die lebendig wirken.

Moderne KI-Bild-zu-Video-Tools erlauben es Kreativen:

- Echtbewegungen zu Porträts und Produkten hinzuzufügen

- Kinoartige Kamerabewegungen aus einem einzelnen Frame zu erzeugen

- Die Identität des Motivs während der Animation zu bewahren

- Bewegung an Musik oder Audio anzupassen (modellabhängig)

- Schnell zu iterieren, ohne die Software zu wechseln

Die Herausforderung ist nicht, ob KI dies kann, sondern welchen KI-Bild-zu-Video-Generator du für jede Aufgabe nutzen solltest. Virtual Try On AI löst dieses Problem, indem es Kreativen Wahlmöglichkeiten bietet.

Was ist der Photo-to-Video Generator von Virtual Try On AI?

Im Kern folgt der Bild-zu-Video Generatior KI von Virtual Try On AI einem einfachen Ablauf:

- Lade einen Startframe (dein Bild) hoch

- Wähle ein Videomodell aus

- Füge eine Bewegungsbeschreibung (Motion Prompt) hinzu

- Bestimme Dauer und Auflösung

- Erstelle und verfeinere das Video

Was ihn unterscheidet, ist die Modellvielfalt. Anstatt einen einzigen Stil vorzuschreiben, integriert Virtual Try On AI mehrere führende Engines – jede mit eigenen Stärken in Realismus, Physik, Storytelling oder Geschwindigkeit.

Von kinorealistischen Bildern bis zu schnellen Social-Clips – diese Flexibilität macht ihn bei vielen Kreativen zum besten KI-Bild-zu-Video-Generator.

Modelle bei Virtual Try On AI (nach Empfehlung sortiert)

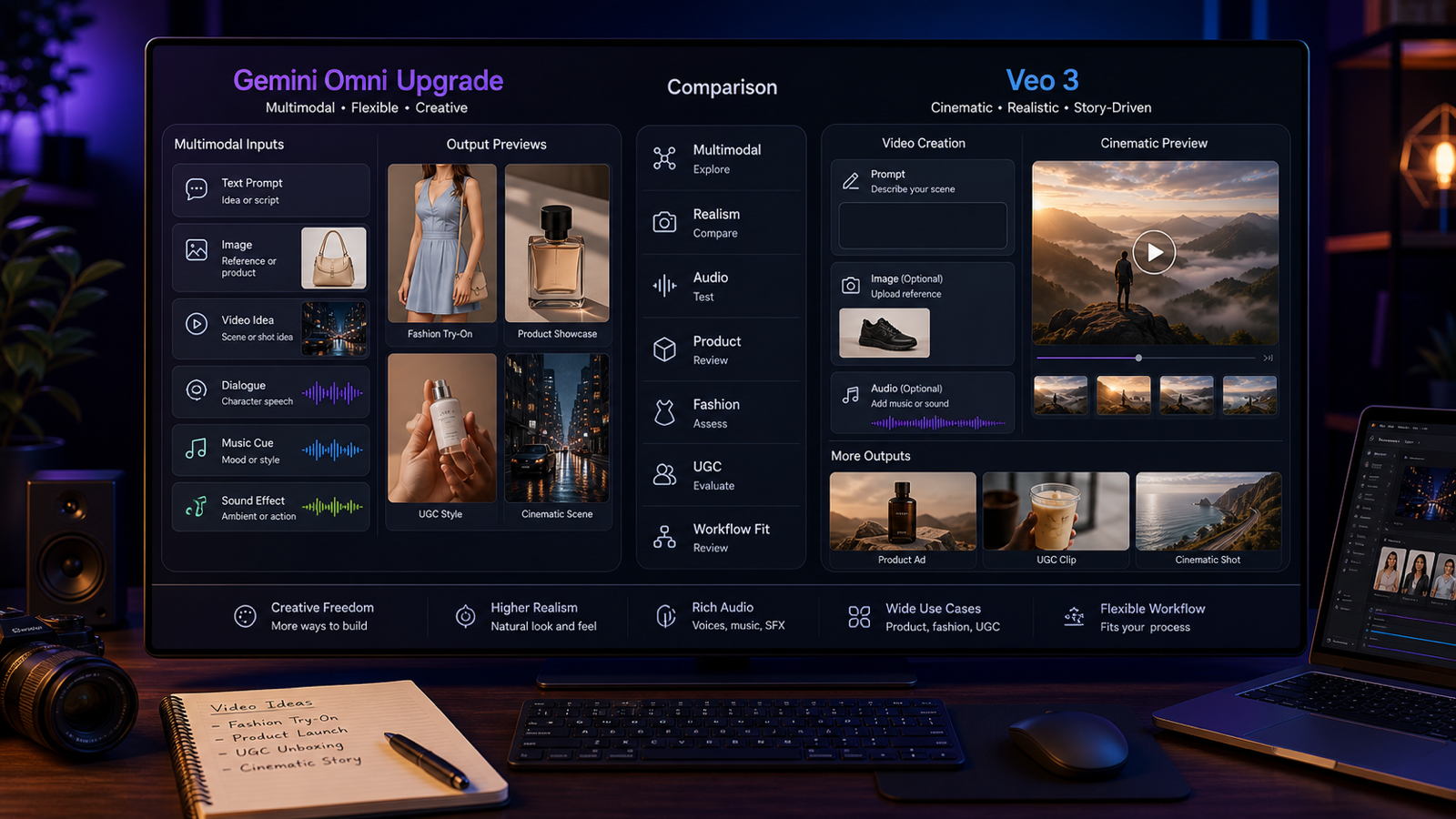

Die Modelle sind unten nach Gesamtqualität, Bewegungsrealismus, Vorgaben-Genauigkeit, Flexibilität und Kreditkosten bewertet.

Tier A: Beste Bild-zu-Video-Modelle insgesamt

Veo 3.1 (Schnell & Standard)

Veo 3.1 ist das präziseste Modell auf der Plattform. Es versteht Eingaben sehr gut und übersetzt sie in saubere, kontrollierte Bewegungen. Dank nativer Audiounterstützung ist es ideal für Werbespots, Erklärvideos und Markeninhalte.

Ideal für:

- Produktanzeigen

- Professionelle Marketing-Clips

- Saubere Kameraführung mit Ton

Warum wählen? Wenn die Genauigkeit der Anweisungen wichtiger ist als visuelles Chaos.

Wan v2.6

Wan v2.6 verbindet Realismus mit kreativer Flexibilität. Die Bewegungen wirken natürlich, ohne steif zu wirken, und es unterstützt Audio-Uploads – dadurch eines der vielseitigsten Modelle.

Ideal für:

- Kinoartige Porträts

- Mode- und Try-on-Visuals

- Umweltbewegungsszenen

Warum wählen? Wenn du Realismus mit kreativem Schliff willst.

Sora 2

Sora 2 legt den Fokus auf natürliches Erzählen. Die Bewegungen fließen logisch von Bild zu Bild, perfekt für kurze narrative Clips und kohärente Szenen.

Ideal für:

- Story-getriebene Visuals

- Emotionale Sequenzen

- Sanfte Bewegungen des Subjekts

Warum wählen? Wenn der Erzählfluss wichtiger ist als Effekte.

Tier B: Modelle für spezielle kreative Anforderungen

Seedance v1 Pro

Seedance ist auf Struktur ausgelegt. Die kohärente Shot-Generierung und Unterstützung des Endframes machen es perfekt für Storyboards und Sequenzen mit sauberen Enden.

Ideal für:

- Storyboards

- Lehrvideos

- Kontrollierte Szenenübergänge

Kling v2.1 Standard

Kling setzt auf cineastische Emotionen. Bewegungen sind expressiv, das Licht wirkt dramatisch, und die Ergebnisse ähneln oft Filmaufnahmen statt technischen Demos.

Ideal für:

- Stimmungsgeladene Visuals

- Dramatische Enthüllungen

- Stilisierten Realismus

Hailuo 2.3 (Schnell & Pro)

Hailuo glänzt bei schnellen Bewegungen. Es verarbeitet komplexe Physik, dynamische Kameraführung und energiegeladene Szenen besser als die meisten anderen Modelle.

Ideal für:

- Actionszenen

- Fantasie-Visuals

- Bewegungsintensive Szenen

Tier C: Schnelle & budgetfreundliche Optionen

Wan v2.5 / Wan v2.5 Schnell

Diese Modelle bieten viel von Wans unverwechselbarem Realismus zu geringeren Kreditkosten. Die Schnellvariante ist ideal für rasches Testen und Iterieren.

Ideal für:

- Tägliche Inhalte

- Social-Media-Clips

- Experimentieren mit Eingaben

Funktionsvergleichstabelle

| Modell | Dauer | Auflösung | Audio | Endframe | Beste Verwendung |

|---|---|---|---|---|---|

| Wan v2.6 | 5–15s | 720–1080p | Ja | Nein | Realistische kinofilmartige Bewegungen |

| Wan v2.5 | 5–10s | 480–1080p | Ja | Nein | Ausgewogener Alltagsgebrauch |

| Wan v2.5 Schnell | 5–10s | 720–1080p | Ja | Nein | Schnelles Iterieren |

| Veo 3.1 | — | — | Ja | Ja | Genauigkeit bei Eingaben + Audio |

| Sora 2 | 10s | — | Nein | Nein | Storytelling |

| Seedance v1 Pro | 5–10s | 720–1080p | Nein | Ja | Narrationskontrolle |

| Kling v2.1 | 5–10s | — | Nein | Nein | Cineastische Emotion |

| Hailuo 2.3 | 6–10s | — | Nein | Nein | Physikintensive Szenen |

Kreditkostenvergleich (Startwerte)

| Modell | Credits | Hinweise |

|---|---|---|

| Sora 2 (10s) | 300 | Starker storytelling-Wert |

| Veo 3.1 Schnell 720p | 300 | Audio + genaue Eingaben |

| Wan v2.5 T2V 480p (5s) | 250 | Günstigster Einstieg bei Wan |

| Wan v2.6 T2V 720p (5s) | 500 | Höhere Realismusstufe |

| Seedance Pro T2V 720p (5s) | 300 | Narrationsfokus |

| Kling v2.1 (5s) | 200 | Kinoeffekt für kleines Budget |

| Hailuo 2.3 Pro (6s) | 450 | Dynamische Physik |

So verwendest du Virtual Try On AI (Schritt-für-Schritt)

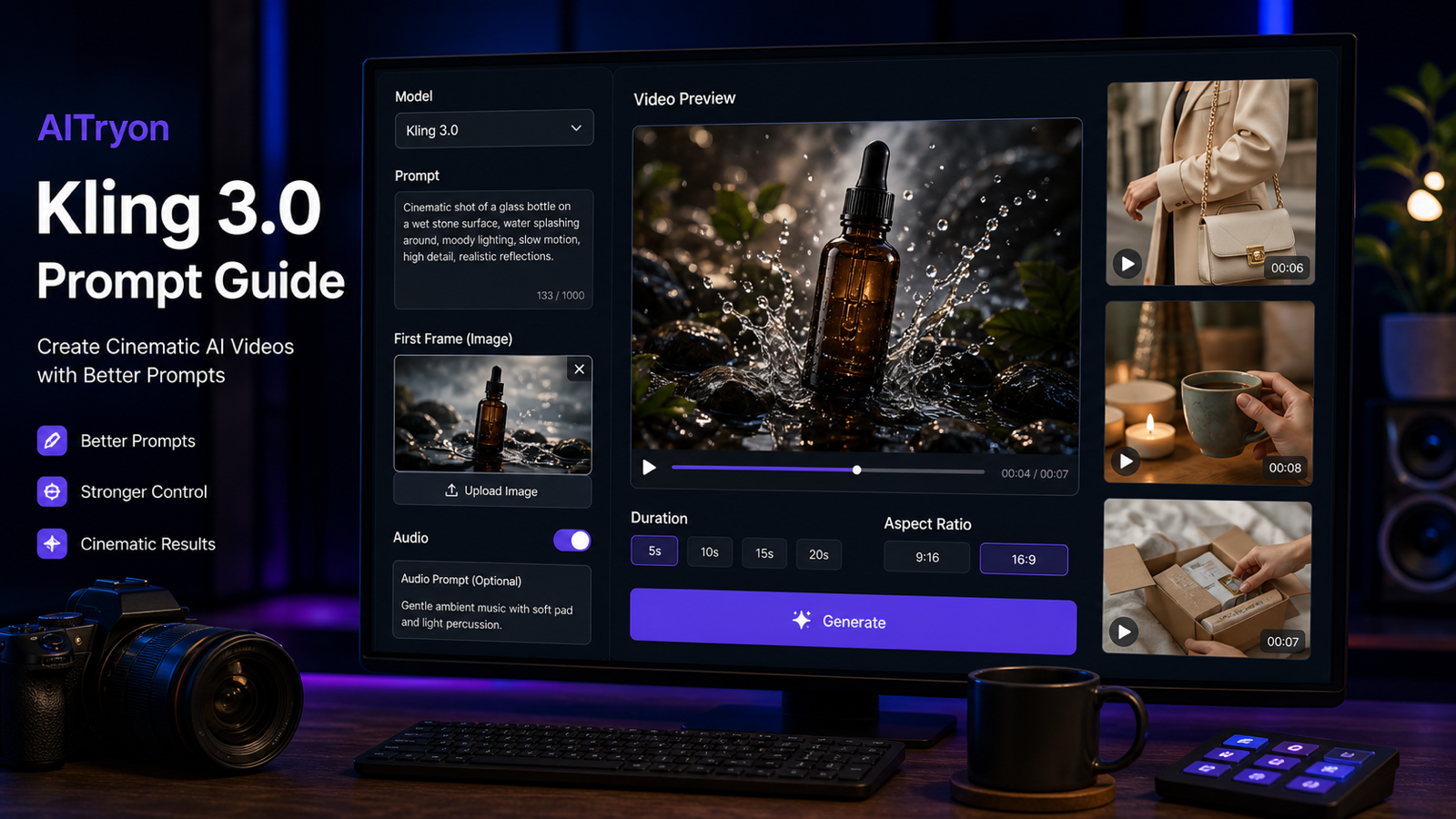

Schritt 1: Modell auswählen

Starte mit Veo 3.1 Schnell oder Wan v2.6 für zuverlässige Ergebnisse.

Schritt 2: Bild hochladen

Bilder mit hoher Auflösung und klarem Motiv funktionieren am besten.

Schritt 3: (Optional) Audio hochladen

Bei Veo- oder Wan-Modellen für synchronisierte Bewegungen.

Schritt 4: Bewegungsbeschreibung schreiben

Beschreibe Bewegungen des Motivs, Kamerafahrten, Umgebung und Stil.

Schritt 5: Dauer und Auflösung einstellen

Teste mit 5s/720p, dann für den Endoutput hochskalieren.

Schritt 6: Generieren und verfeinern

Kleine Änderungen der Eingabe führen oft zu großen Verbesserungen.

Warum Virtual Try On AI 2026 ein Super-Hub für KI-Video ist

Was Virtual Try On AI auszeichnet, ist nicht nur Qualität – es ist die Auswahl.

- Mehrere Top-Modelle in einer Oberfläche

- Klare Übersicht über Funktionen und Kreditkosten

- Einfacher Wechsel von schnellen Tests zu Premium-Ausgaben

- Ideal für Creators mit unterschiedlichen Stilen und Budgets

Statt ständig nach der „besten KI von Bild zu Video“ zu jagen, können Nutzer experimentieren, vergleichen und skalieren – alles an einem Ort.

Fazit

Wenn du eine flexible, nutzerorientierte KI-Bild-zu-Video-Plattform suchst, die mit deinen Bedürfnissen wächst, ist der Photo-to-Video Generator von Virtual Try On AI eine der stärksten Optionen 2026.

Ob Social-Clips, kinoreife Visuals oder Produktanimationen – er gibt dir die Freiheit, jedes Mal das richtige Modell zu wählen.

👉 Hier ausprobieren: https://aitryon.art/photo-to-video/