Trasformare una singola immagine in una scena vivente e in movimento non richiede più software di animazione, motion designer o settimane di post-produzione. Nel 2026, l’intelligenza artificiale da immagine a video è diventata uno strumento creativo pratico che chiunque può utilizzare—se sceglie la piattaforma giusta.

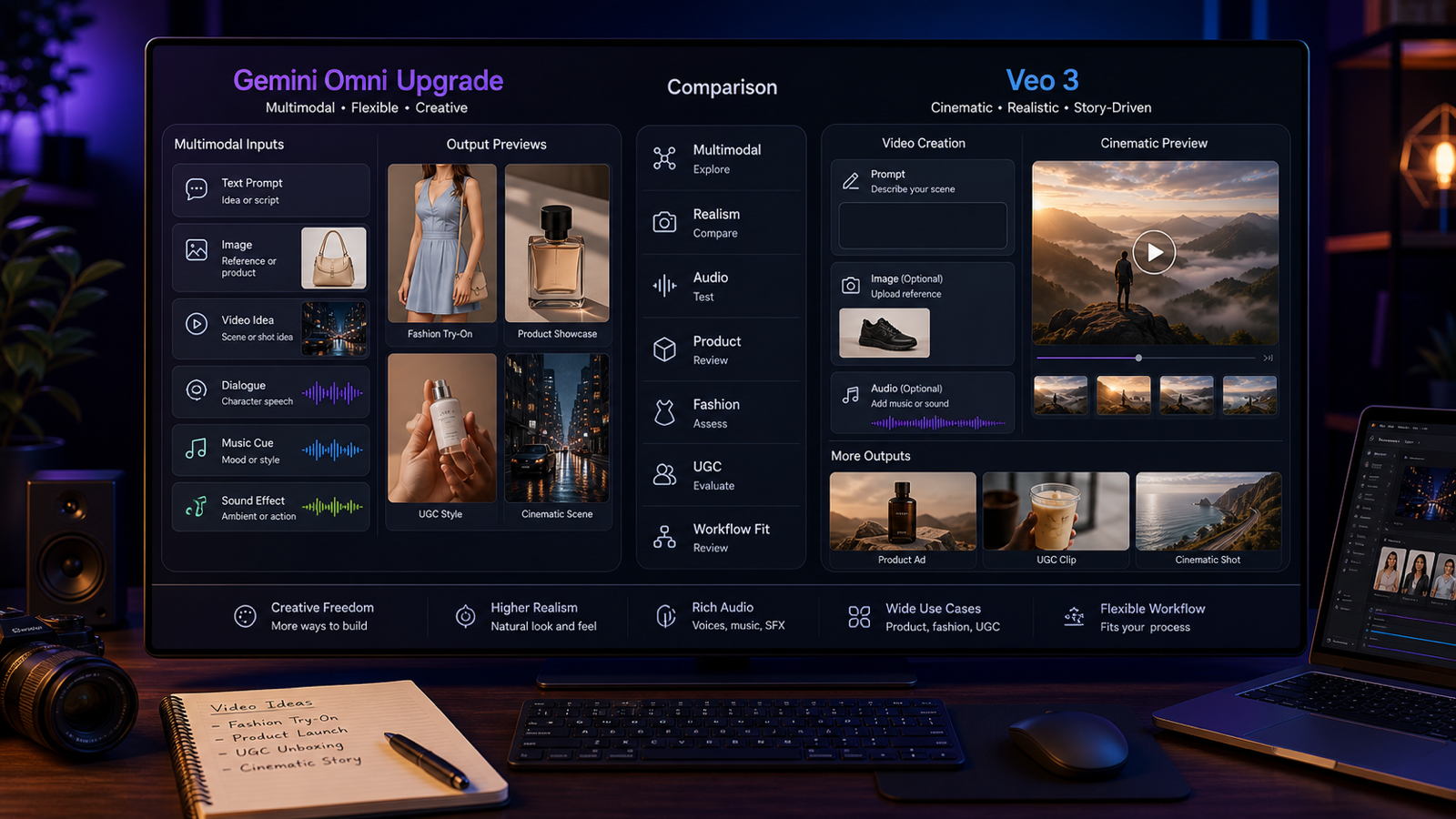

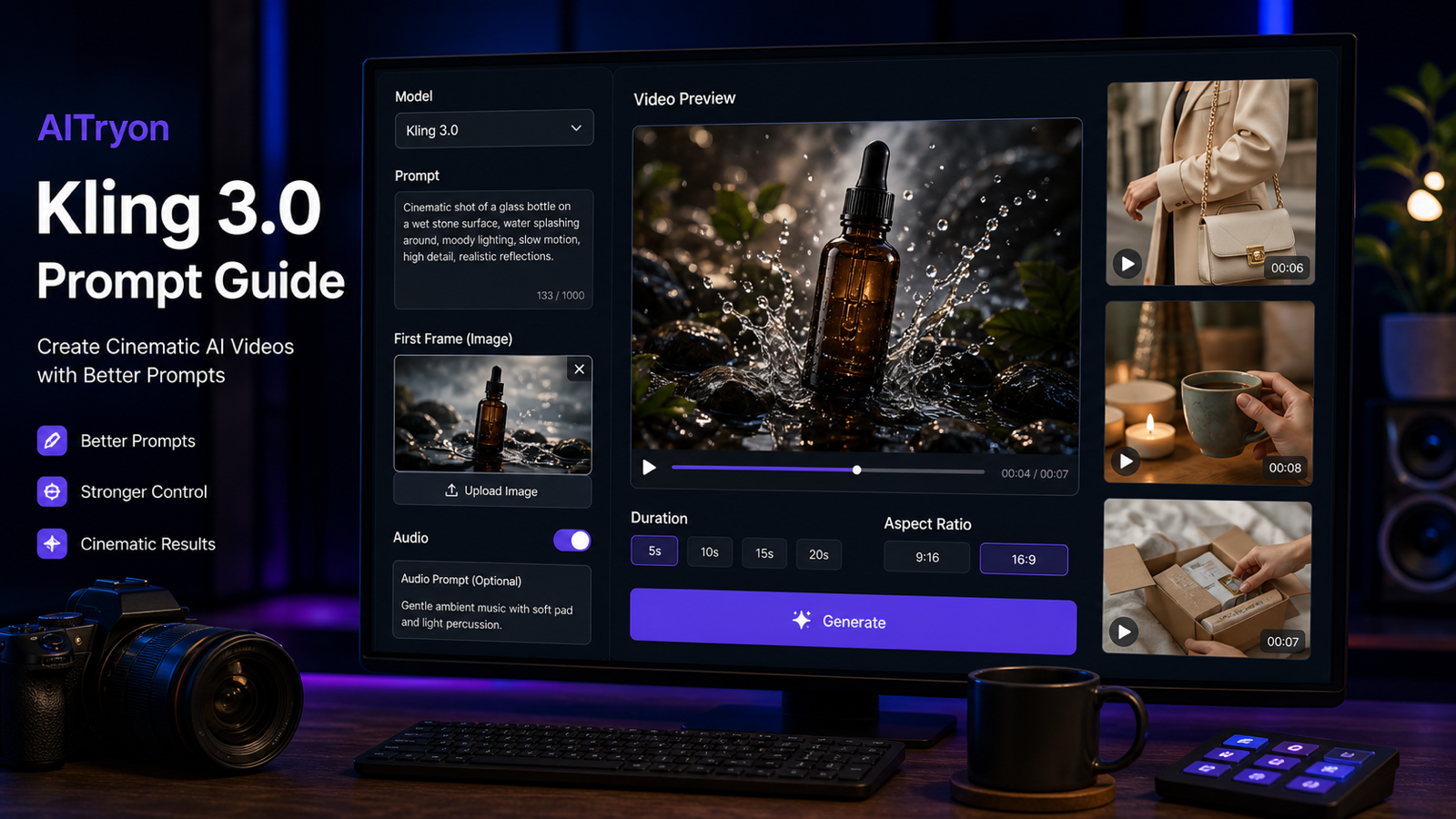

È qui che entra in gioco Virtual Try On AI’s Photo-to-Video Generator. Invece di vincolare i creatori a un solo modello o a un’estetica unica, funziona come un hub centrale per molteplici modelli video di altissima qualità, permettendoti di scegliere il motore giusto per ogni scena, budget e stile.

Che tu stia cercando la migliore AI da immagine a video per pubblicità, narrazione, visual moda o contenuti brevi per i social, questa guida spiega come funziona lo strumento, quali modelli usare e perché Virtual Try On AI è diventata nel 2026 una piattaforma di riferimento per l’AI da immagine a video.

Perché l’AI da immagine a video è importante nel 2026

Le immagini statiche fanno fatica a competere nei feed di oggi. Le piattaforme premiano il movimento, la profondità e l’emozione—e il pubblico si aspetta contenuti che sembrino vivi.

Gli strumenti moderni di AI da immagine a video permettono ai creatori di:

- Aggiungere movimento realistico a ritratti e prodotti

- Creare movimenti di camera cinematografici partendo da un solo fotogramma

- Conservare l'identità del soggetto mentre lo si anima

- Sincronizzare il movimento con musica o audio (dipende dal modello)

- Iterare rapidamente senza cambiare software

La sfida non è se l’AI può farlo, ma quale generatore AI da immagine a video usare per ogni compito. Virtual Try On AI risolve questo problema offrendo ai creatori la scelta.

Cos’è il Photo-to-Video Generator di Virtual Try On AI?

Alla base, il generatore AI da immagine a video di Virtual Try On AI segue un flusso di lavoro semplice:

- Carica un fotogramma di partenza (la tua immagine)

- Scegli un modello video

- Aggiungi un prompt di movimento

- Imposta durata e risoluzione

- Genera e perfeziona

Ciò che lo distingue è la line-up dei modelli. Invece di imporre uno stile unico, Virtual Try On AI integra diversi motori leader—ognuno con punti di forza distinti in realismo, fisica, narrazione o velocità.

Dal realismo cinematografico ai clip social veloci, questa flessibilità è il motivo per cui molti creatori lo considerano ora uno dei migliori generatori AI da immagine a video disponibili.

Modelli presenti su Virtual Try On AI (classificati per raccomandazione)

I modelli sono ordinati qui sotto in base alla qualità generale dell’output, realismo del movimento, aderenza al prompt, flessibilità e valore in crediti.

Tier A: Migliori modelli da immagine a video in assoluto

Veo 3.1 (Fast & Standard)

Veo 3.1 è il modello più preciso sulla piattaforma. Eccelle nell’interpretare i prompt e tradurli in un movimento pulito e controllato. Il supporto audio nativo lo rende ideale per spot, video esplicativi e contenuti brandizzati.

Ideale per:

- Pubblicità di prodotto

- Clip marketing professionali

- Movimenti di camera puliti con audio

Perché sceglierlo: Quando la precisione del prompt conta più del caos visivo.

Wan v2.6

Wan v2.6 bilancia realismo e flessibilità creativa. Il movimento sembra naturale senza diventare rigido, e supporta il caricamento audio—rendendolo una delle opzioni più versatili.

Ideale per:

- Ritratti cinematografici

- Visual moda e try-on

- Scene con movimento ambientale

Perché sceglierlo: Quando vuoi realismo con un tocco creativo.

Sora 2

Sora 2 si concentra sulla narrazione naturale. Il movimento scorre logicamente da un fotogramma all’altro, perfetto per clip narrative brevi e scene coerenti.

Ideale per:

- Visual narrativi

- Sequenze emotive

- Movimento fluido del soggetto

Perché sceglierlo: Quando il flusso narrativo è più importante degli effetti.

Tier B: Modelli per esigenze creative specifiche

Seedance v1 Pro

Seedance è pensato per la struttura. La sua generazione coerente dei colpi e il supporto per il fotogramma finale lo rendono perfetto per storyboard e sequenze con finali puliti.

Ideale per:

- Storyboard

- Clip educativi

- Transizioni di scena controllate

Kling v2.1 Standard

Kling punta sull’emozione cinematografica. Il movimento è espressivo, l’illuminazione drammatica e i risultati sembrano spesso inquadrature da cortometraggio più che demo tecniche.

Ideale per:

- Visual basati sull’umore

- Rivelazioni drammatiche

- Realismo stilizzato

Hailuo 2.3 (Fast & Pro)

Hailuo brilla quando le cose devono muoversi velocemente. Gestisce meglio di molti modelli fisica complessa, movimenti dinamici di camera e scene ad alta energia.

Ideale per:

- Sequenze d’azione

- Visual fantasy

- Scene con molto movimento

Tier C: Opzioni rapide e a basso costo

Wan v2.5 / Wan v2.5 Fast

Questi modelli offrono gran parte del realismo distintivo di Wan a un costo in crediti inferiore. La variante Fast è ideale per test rapidi e iterazioni veloci.

Ideale per:

- Contenuti quotidiani

- Clip social media

- Sperimentazione di prompt

Tabella di confronto delle funzionalità

| Modello | Durata | Risoluzione | Audio | Fotogramma finale | Miglior uso |

|---|---|---|---|---|---|

| Wan v2.6 | 5–15s | 720–1080p | Sì | No | Movimento cinematografico realistico |

| Wan v2.5 | 5–10s | 480–1080p | Sì | No | Uso quotidiano bilanciato |

| Wan v2.5 Fast | 5–10s | 720–1080p | Sì | No | Iterazione veloce |

| Veo 3.1 | — | — | Sì | Sì | Precisione prompt + audio |

| Sora 2 | 10s | — | No | No | Narrazione |

| Seedance v1 Pro | 5–10s | 720–1080p | No | Sì | Controllo narrativo |

| Kling v2.1 | 5–10s | — | No | No | Emozione cinematografica |

| Hailuo 2.3 | 6–10s | — | No | No | Scene con fisica complessa |

Confronto costi in crediti (punti di partenza)

| Modello | Crediti | Note |

|---|---|---|

| Sora 2 (10s) | 300 | Forte valore narrativo |

| Veo 3.1 Fast 720p | 300 | Audio + precisione prompt |

| Wan v2.5 T2V 480p (5s) | 250 | Minimo costo per Wan |

| Wan v2.6 T2V 720p (5s) | 500 | Livello di realismo superiore |

| Seedance Pro T2V 720p (5s) | 300 | Focus narrativo |

| Kling v2.1 (5s) | 200 | Cinematografico con budget |

| Hailuo 2.3 Pro (6s) | 450 | Fisica dinamica |

Come usare Virtual Try On AI (passo dopo passo)

Passo 1: Scegli un modello

Inizia con Veo 3.1 Fast o Wan v2.6 per risultati affidabili.

Passo 2: Carica la tua immagine

Funzionano meglio immagini ad alta risoluzione con soggetti ben definiti.

Passo 3: (Opzionale) Carica audio

Usa con i modelli Veo o Wan per sincronizzare il movimento.

Passo 4: Scrivi un prompt di movimento

Descrivi il movimento del soggetto, la camera, l’ambiente e lo stile.

Passo 5: Imposta durata e risoluzione

Testa a 5s/720p, poi aumenta per l’output finale.

Passo 6: Genera e perfeziona

Piccole modifiche al prompt spesso portano a grandi miglioramenti.

Perché Virtual Try On AI è un super hub per video AI nel 2026

Ciò che distingue Virtual Try On AI non è solo la qualità, ma la scelta.

- Molteplici modelli top-tier in un’unica interfaccia

- Chiara visibilità di funzionalità e costi in crediti

- Facile passaggio da test rapidi a output premium

- Ideale per creatori che lavorano su stili e budget diversi

Invece di inseguire il “migliore AI da immagine a video”, i creatori possono sperimentare, confrontare e scalare—tutto in un unico posto.

Verdetto finale

Se vuoi una piattaforma AI da immagine a video flessibile e pensata prima di tutto per i creatori, che cresca con le tue esigenze, il Photo-to-Video Generator di Virtual Try On AI è una delle opzioni più solide nel 2026.

Che tu produca clip social, visual cinematografici o animazioni di prodotto, ti offre la libertà di scegliere il modello giusto ogni volta.

👉 Provalo qui: https://aitryon.art/photo-to-video/